关键亮点

- 大型语言模型(LLMs) 生成式预训练 Transformer (GPT) 模型都是利用自然语言处理和机器学习技术的 AI 模型。

- LLM经过大量文本数据的训练,可以执行摘要、翻译、内容生成和聊天机器人支持等任务。

- GPT 模型,特别是 OpenAI 的 ChatGPT,是一种特定类型的 LLM 使用转换器架构来生成类似人类的文本响应。

- 以上皆是 LLMs 和 GPT 模型各有其优点和局限性,了解它们的差异有助于为特定应用选择正确的模型。

- LLM需要大量的训练和微调过程,而 GPT 模型是经过预先训练的,可以针对特定任务进行微调。

- LLM擅长文本生成和理解,而 GPT 模型则特别注重以对话方式生成文本响应。

引言

大型语言模型(LLM) 和生成式预训练 Transformer (GPT) 模型正在彻底改变人工智能 (AI) 和自然语言处理 (NLP)。理解两者之间的区别 LLM 和 GPT 是人工智能和自然语言处理 (NLP) 领域中两个常用的缩写,理解它们在各个行业中的独特功能和应用至关重要。虽然两者都在文本生成方面表现出色,但它们的底层架构和性能指标却有所不同。深入探究这些模型的细微差别,将有助于理解它们如何重塑人工智能和机器学习的格局。

什么是大型语言模型(LLM)

大型语言模型(LLMs) 指的是为各种自然语言处理任务而设计的一类广泛的语言模型。GPT 模型属于这一类别,是一种特定类型的 LLM。 术语 ”LLM”涵盖了该领域使用的任何广泛的语言模型。

主要特点 LLM

LLM机器学习具备多项关键特性,使其成为自然语言处理和人工智能应用的强大工具。这些特性包括:

- 可扩展性:大型语言模型(LLMs)以其可扩展性而著称,其规模从较小的版本到像 GPT-3 这样的超大版本不等。 LLM 极大地影响了其能力。

- 架构多样性:与使用 Transformer 架构的 GPT 模型不同, LLM可以使用各种架构来构建,包括循环神经网络 (RNN) 和卷积神经网络 (CNN)。

- 广泛的应用: LLM适用于情感分析、文本摘要和语言翻译等众多 NLP 任务,展示了其在解决各种挑战方面的广泛适用性。

- 数据驱动学习: LLMs 在广泛的数据集上进行训练,包括来自书籍、文章和网站的文本,从而使它们能够学习和复制复杂的语言模式和细微差别。

- 道德挑战: LLM由于训练数据可能反映人类语言中存在的偏见,因此面临着偏见和伦理问题。这些挑战引发了关于负责任的人工智能使用和模型行为的持续争论。

什么是生成式预训练 Transformer (GPT)

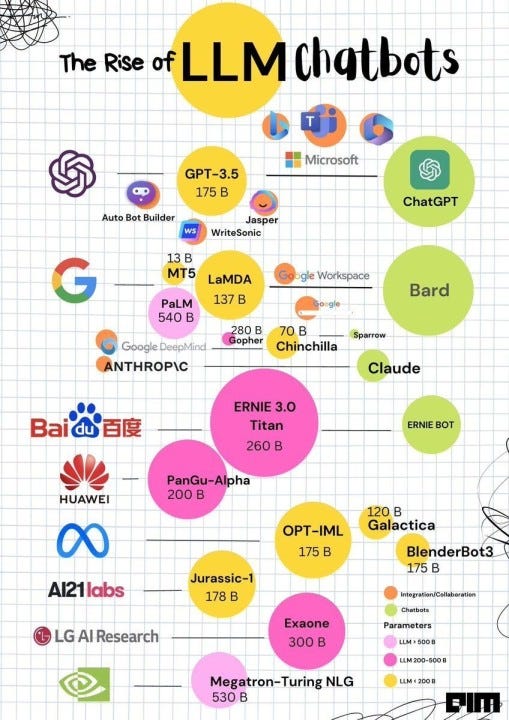

生成式预训练 Transformer(通常称为 GPT)是 OpenAI 创建的一系列自然语言处理 (NLP) 模型。这些模型被设计为生成和理解类似于人类语言的文本,并响应提供给它们的输入。GPT-3 是最新、最突出的版本,也是迄今为止该系列中最大的模型。

GPT 的主要功能

GPT 模型在生成连贯且上下文相关的文本方面表现出色,这是一项称为“文本补全”的基本功能。GPT 的主要特点包括:

- 预训练:GPT 模型对来自互联网的海量数据集进行大量预训练,以学习语言结构、语法、语义和上下文。

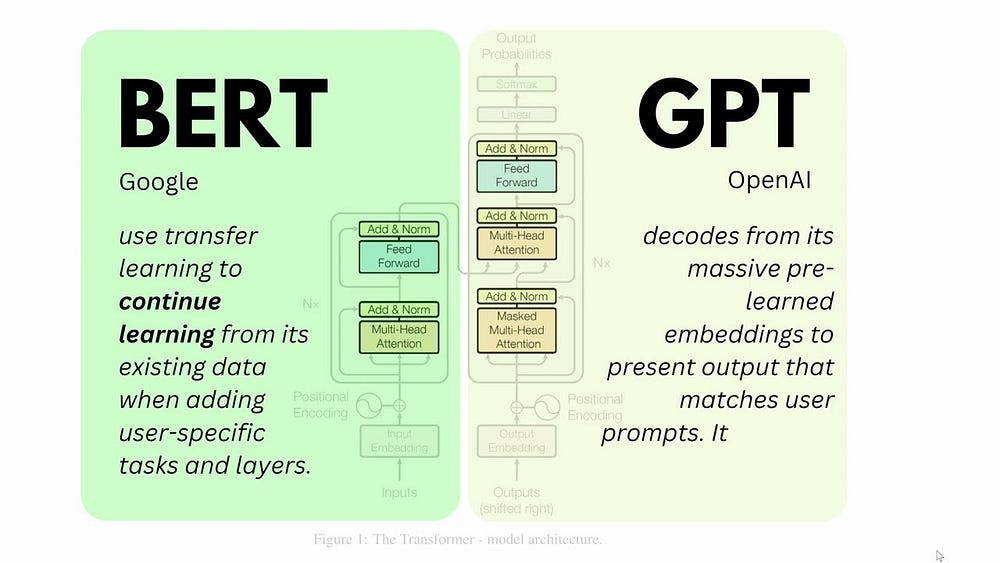

- Transformer 架构:基于 Transformer 框架的 GPT 模型能够高效处理数据序列。这种架构让模型能够在文本生成过程中考虑句子中每个单词的上下文。

- 微调:预训练后,GPT 模型可以针对特定任务或行业进行微调,从而提高其在语言翻译、文本完成或问答等领域的性能。

- 大规模:例如,GPT-3 是一个拥有 175 亿个参数的庞大模型,是现存最大的语言模型之一。其庞大的规模显著提升了其文本生成能力。

- 类人文本生成:GPT 模型以生成与人类写作极为相似的文本而闻名,它擅长撰写文章、回答问题,甚至创作诗歌,通常很难区分人类和机器的输出。

对比分析: LLM 与 GPT 相比

现在我们已经充分了解了 GPT 和 LLM 让我们继续进行比较分析,看看 GPT 和 LLM.

训练数据和规模

GPT

GPT 模型以规模庞大而著称,例如,GPT-3 已在 570GB 的各种文本数据(如互联网文本、书籍和文章)上进行了预训练。如此大量的训练数据对于其高级语言生成功能至关重要。

LLM

LLM涵盖了各种规模和训练数据量各异的模型。从像 GPT-2 这样拥有 1.5 亿个参数的小型模型,到像 GPT-3 这样拥有 175 亿个参数的大型模型,不一而足。 LLMs 通常与 GPT 类似,但根据每个模型的具体设计和目标而有所不同。

主要区别

训练数据和规模的主要区别在于,GPT-3 代表了更广泛类别中的一个特定实例 LLMs,位于规模范围的高端。

架构和功能

GPT

GPT 模型采用 Transformer 架构,该架构擅长处理数据序列,因此对各种 NLP 任务都非常有效。这些模型尤其以文本生成和补全而闻名。

LLM

LLM采用多种架构,包括 Transformers、RNN 和 CNN,根据模型目标定制可扩展性和灵活性。 LLM支持文本生成之外更广泛的 NLP 任务。

主要区别

架构和功能上的关键区别在于,GPT 模型完全建立在 Transformer 架构之上,主要因其文本生成能力而受到认可,而 LLMs 包含多种架构和更广泛的应用范围。

用例和应用程序

GPT

GPT 模型(例如 GPT-3)因生成与人类书写极为相似的文本而广受好评,可用于内容创建、回答问题、语言翻译、聊天机器人和创意写作。GPT-3 在理解和生成自然语言方面表现出卓越的能力。

LLM

作为一个更广泛的类别, LLM其广泛应用于各种应用,例如情绪分析、文本摘要、语言翻译、文本分类等等。它们可以针对医疗保健、金融和客户服务等特定领域进行定制,满足行业特定需求。

主要区别

虽然 GPT 模型因其文本生成技能而备受推崇, LLMs 可用于更广泛的 NLP 任务,凸显了它们的多功能性。

伦理和社会影响

GPT

GPT 模型的大规模使用引发了有关偏见、错误信息和潜在滥用的伦理争论,尤其是 GPT-3 生成类似人类文本的能力,引发了人们对人工智能在内容创作中是否负责任地使用的质疑。

LLM

伦理问题 LLM人工智能还涉及偏见和隐私问题,并延伸至不同应用中负责任地使用人工智能。鉴于人工智能在各行各业的广泛应用,根据每个应用的具体情况,量身定制伦理问题至关重要。

主要区别

GPT 模型相关的伦理和社会影响以及 LLM类似情况也引发了人们对偏见和负责任的人工智能使用的担忧。具体担忧可能因模型的应用和规模而异。

现有应用 LLM 以及各行各业的GPT

大型语言模型(LLM深度学习(s)和生成式预训练 Transformer(GPT)模型已在各行各业得到广泛应用。让我们分别来了解一下。

现有应用 LLM

近年来,众多大型语言模型在各种自然语言处理任务中表现出色。以下是一些突出的例子:

- BERT(Transformers 的双向编码器表示):BERT 由 Google 创建,是一种预先训练的 Transformer 模型,以其对上下文细微差别的理解能力而闻名。它在情绪分析、问答和命名实体识别方面树立了新的标杆。

- RoBERTa(稳健优化的 BERT 预训练方法):RoBERTa 是 Facebook 开发的 BERT 的增强版本,它采用先进的预训练方法和更大的数据集,在多个基准测试中取得了优异的结果。

- GPT-2、GPT-3 和 GPT-4(生成式预训练 Transformer):GPT 系列模型由 OpenAI 开发,是功能强大的语言模型,擅长生成类似人类的文本。它们在大量文本数据上进行了预训练,可以针对各种应用进行微调,例如对话、翻译和摘要。

- ALBERT(精简版 BERT):BERT 的精简版本采用参数共享技术来减少参数总数,从而节省内存和计算资源,同时保持强大的性能。

- 聊天完成 作者:Novita.ai:这 LLM 聊天 API 让您能够就任何您选择的主题进行对话。它们对您的对话不受限制、不受规则、不受审查。

GPT 的现有应用

除了前面提到的大型语言模型之外,还有几种通用的预训练转换器,可用于各种任务,包括计算机视觉、语音识别和强化学习。一些值得注意的例子包括:

- Vision Transformer (ViT):ViT 是一种 Transformer 模型,最初是为计算机视觉任务进行预训练的。它将图像处理为图像块序列,利用 Transformer 的强大功能执行图像分类等任务。

- DETR(检测变压器):DETR 将变压器框架应用于对象检测和图像分割,直接对图像区域和对象类别之间的关系进行建模,从而无需使用锚框或非最大抑制等传统技术。

- Conformer:Conformer 将 Transformer 架构与卷积神经网络 (CNN) 相结合,以增强语音识别任务。它在自动语音识别 (ASR) 和关键词识别方面表现出色。

- Swin Transformer:Swin Transformer 专为计算机视觉而设计,采用分层结构,可实现高效的图像处理,使其擅长处理高分辨率图像和扩展到更大的数据集。

- 感知器和感知器 IO:这些多功能转换器模型可以处理多种数据类型,包括图像、音频和文本。它们具有独特的注意力机制,可以有效处理大量输入,使其适用于各种应用。

结语

总之,理解大型语言模型(LLM) 和生成式预训练 Transformer (GPT) 模型对于有效利用其功能至关重要。虽然 LLMGPT 模型提供与其演进相适应的特定功能,在生成内容创作方面表现出色。它们的比较分析揭示了架构差异和应用范围。GPT 的未来 LLM 通用数据技术 (GPT) 在人工智能发展中展现出光明的前景,其中伦理考量和数据隐私至关重要。克服这些技术在实施过程中的挑战,需要解决偏见问题并确保人工智能模型的公平性,这凸显了它们在塑造人工智能研究和机器学习未来方面的关键作用。

常見問題解答

与其他模型相比,GPT 模型有何独特之处 LLMs?

包括 OpenAI 的 ChatGPT 在内的 GPT 模型与其他大型语言模型相比具有独特性(LLMs) 是因为它们使用了变压器架构和注意力机制。

怎么做 LLM 和 GPT 模型会影响未来的工作吗?

这些人工智能模型可以自动执行任务、提高生产力,并为各个行业提供智能帮助,包括内容创建、客户支持和数据分析。

novita.ai一站式平台,无限创意,让您访问 100 多个 API。从图像生成和语言处理到音频增强和视频处理,价格低廉,按需付费,让您摆脱 GPU 打造您自己的产品时,无需担心维护问题。免费试用。

推荐阅读

探索 Novita 的更多内容

订阅即可将最新帖子发送到您的电子邮箱。